يعتقد خبراء التقنية أن العالم سيصبح مختلفًا تمامًا بعد 10 سنوات من الآن بفعل تقنيات الذكاء الاصطناعي، ولكن السؤال الذي يشغل بال صناع السياسات في كافة القطاعات هو: هل سيحدث التغيير لأن أدوات الذكاء الاصطناعي ستطلق العنان للإبداع البشري وستزيد الإنتاجية؟ أم لأنها ستستولي على معظم المهام الوظيفية التي يؤديها الإنسان؟

في أواخر العام الماضي، أحدث الذكاء الاصطناعي التوليدي طفرة في المجالات التقنية، فمع ظهور أدوات الدردشة المدعومة به، مثل "ChatGPT" ومن ثم "Bard" وغيرهما، أصبح تحرير النصوص والصور وإنشاء الأكواد البرمجية وتأليف المقالات الإبداعية آليًا أسهل من ذي قبل.

ورغم الفوائد الكثيرة، انتشر التزييف على نطاق واسع، وتصاعد القلق من أن تقنيات الذكاء الاصطناعي ستستولي على وظائف البشر، خاصة وأنها يمكنها إنجاز مهام كانت تستغرق ساعات في السابق في ثوانٍ معدودة.

في هذا التقرير، نسلط الضوء على شعور الناس تجاه ظهور الذكاء الاصطناعي وتطوره وكيف سيشكل حياتنا، والمخاوف التي تحيط به، وآراء الخبراء في ما يجب فعله للاستعداد للتغييرات التي سيحدثها.

أجرت شركة "Ipsos" استطلاعًا للرأي حول كيف يتوقع الناس أن يغير الذكاء الاصطناعي حياتهم وطريقة عملهم، في الفترة من 26 مايو إلى 9 يونيو 2023، شارك فيه أكثر من 22 ألف شخص من 31 دولة حول العالم.

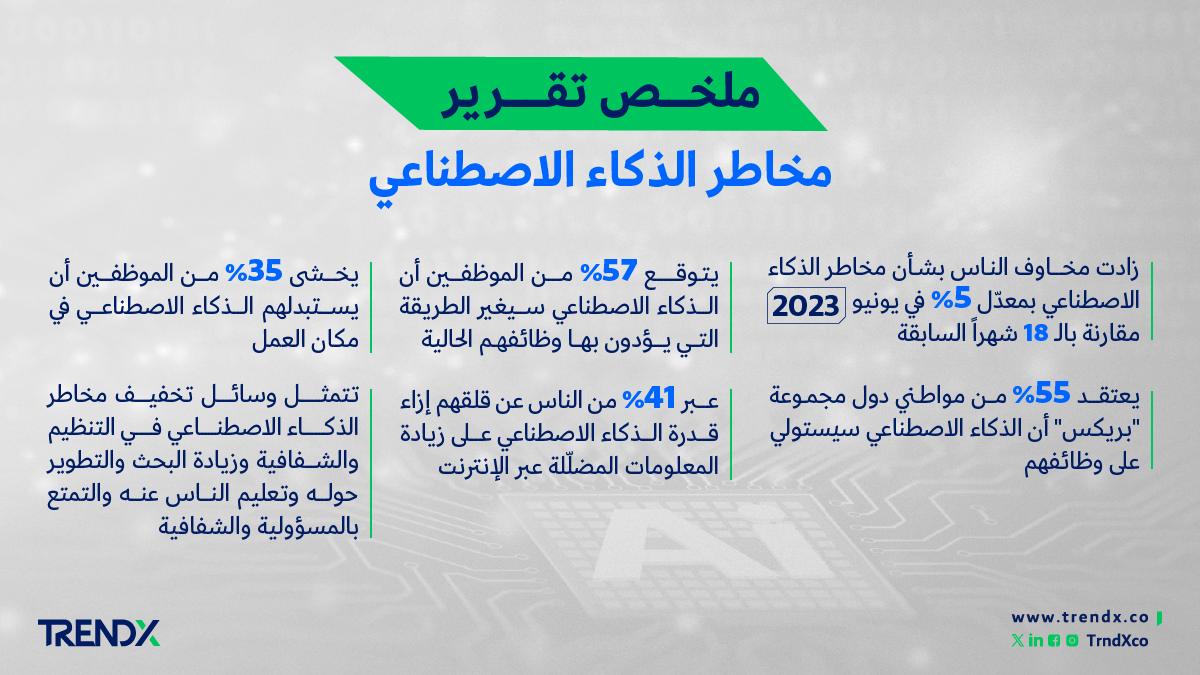

سجّلت الشركة زيادة بنسبة 13% في متوسط تخوّف الناس من تأثير تطور تقنيات الذكاء الاصطناعي على وظائفهم مقارنة بالفترة التي سبقت المدى الزمني لإجراء الاستطلاع بـ 18 شهرًا.

وفي المتوسط، يتوقع 57% من الموظفين أن يغير الذكاء الاصطناعي الطريقة التي يؤدون بها وظائفهم الحالية، بينما يذهب 35% منهم إلى التوقع بأن الذكاء الاصطناعي سيحل محلهم في وظائفهم الحالية، و8% لا يتبنون أي الرأيين.

وبحسب نتائج استطلاع الرأي، يبدو أن مواطني دول مجموعة "بريكس" هم الأكثر تشاؤمًا، حيث أن 55% منهم يعتقدون أن الذكاء الاصطناعي سيستولي على وظائفهم خلال السنوات الخمس القادمة، في مقابل 51% من سكان منطقة الشرق الأوسط وشمال أفريقيا.

ويرى 45% من سكان منطقة آسيا والمحيط الهادئ أن هناك احتمالية لاستبدال وظائفهم بالذكاء الاصطناعي، ويؤيد هذا الرأي 43% من مواطني أمريكا الشمالية، و27% من دول مجموعة السبع، و26% من أوروبا، و25% من أمريكا الشمالية.

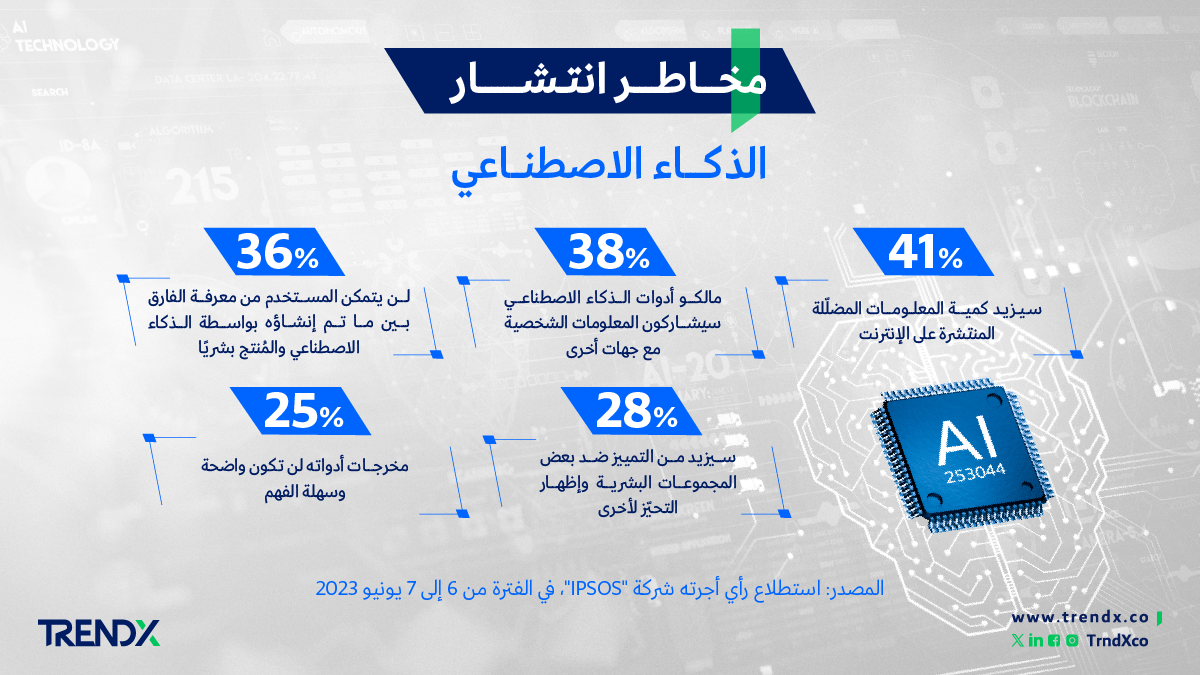

هناك مجموعة متنوعة من المخاوف التي تحيط بانتشار الذكاء الاصطناعي، حيث يخشى 28% من الناس من أن هذه التقنيات ستزيد من التمييز ضد مجموعات من الأشخاص وإظهار التحيز لأخرى.

ويعتقد 25% ممن شاركوا في استطلاع الرأي أن مخرجات أدوات الذكاء الاصطناعي لن تكون واضحة أو سهلة الفهم، بينما يخشى 38% أن مشغلي هذه الأدوات قد يسرّبون بياناتهم الشخصية.

ويتخوف 36% من الناس من أنهم لن يكونوا قادرين على التفريق بين المواد التي يتم إنتاجهة بواسطة الذكاء الاصطناعي، وتلك الناتجة عن الإبداع البشري.

وتصل نسبة المتخوفين من أن الذكاء الاصطناعي سيساعد في زيادة المعلومات المضللة على شبكة الإنترنت إلى 41%.

وبالنسبة للمخاطر على الشركات والأعمال، يمكن الاستفادة من إمكانيات الذكاء الاصطناعي المتعلقة بإنتاج الصوت في صنع تسجيلات صوتية تحاكي أصوات المديرين التنفيذيين للشركات لخداع الموظفين أو الحصول على معلومات سرية.

ويمكن للذكاء الاصطناعي أن يلحق ضررًا كبيرًا بسمعة أي شركة، من خلال صنع مقاطع فيديو أو صور غير واقعية للمديرين والموظفين، وهو ما يردي بالنهاية لخسائر مالية كبيرة.

كما يمكن من خلال أدوات الذكاء الاصطناعي مثل "WormGPT" أن تسعد في شن هجمات متطورة على البريد الإلكتروني التجاري للشركات والاستيلاء على معلومات منها.

يتفق خبراء التقنية وصناع السياسات على أن هناك العديد من الخطوات التي يمكن اتخاذها للتخفيف من المخاطر المرتبطة بالذكاء الاصطناعي، ومن أهمها:

- التنظيم: يجب على الحكومات والمنظمات الدولية وضع لوائح لتطوير ونشر واستخدام الذكاء الاصطناعي؛ لحماية المواطنين من الأضرار المحتملة، مثل التأثير على وظائفهم، وانتهاكات الخصوصية، والتهديدات الأمنية.

- الشفافية: يجب أن يعرف المستخدم كيف تعمل أنظمة الذكاء الاصطناعي وطبيعة البيانات التي تجمعها عنهم؛ لمنع التحيز والتأكد من أن النظام عادل وخاضع للمساءلة.

- البحث: نحن بحاجة إلى مواصلة الاستثمار في الأبحاث لفهم المخاطر المحتملة للذكاء الاصطناعي وكيفية التخفيف منها.

- التعليم: هناك حاجة إلى تثقيف الناس حول الذكاء الاصطناعي، حتى يتمكنوا من فهم الفوائد والمخاطر المحتملة، واتخاذ قرارات مستنيرة حول كيفية استخدامه.

- المسؤولية الأخلاقية: يحتاج الناس أن يكون تطوير الذكاء الاصطناعي قائمًا على اعتبارات أخلاقية مسؤولة، ويمكن أن يشمل ذلك وضع قوانين للاستخدام، وقواعد للالتزام بها من قبل مطوري أدواته.

ولمعالجة المخاطر على الأعمال المرتبطة بالذكاء الاصطناعي بشكل فعال، يجب على الشركات إنشاء فريق عمل متخصص في علوم البيانات والأمن السيبراني لأداء بعض المهام، والتي تشمل:

- إدارة المخاطر: تحديد التهديدات المحتملة وتحليلها، وصياغة استراتيجيات للتخفيف منها بشكل فعال.

- التعليم والتدريب: تعزيز ثقافة محو الأمية في مجال الذكاء الاصطناعي، وتوفير التدريب للموظفين للتعرف على أنواع التهديدات والاستجابة لها.

- الاستجابة للأزمات: تطوير خطط للتعامل مع حالات الطوارئ المتعلقة بتأثير الذكاء الاصطناعي على سمعة المؤسسة.

- زادت مخاوف الناس من مخاطر تقنيات الذكاء الاصطناعي بمعدّل 13%، في يونيو 2023، مقارنة بالـ 18 شهرًا السابقة له.

- يتوقع 57% من الموظفين أن الذكاء الاصطناعي سيغير الطريقة التي يؤدون بها وظائفهم الحالية، بينما يذهب 35% إلى أن الذكاء الاصطناعي سيستبدلهم.

- مواطنو دول مجموعة "بريكس" هم الأكثر تشاؤمًا بشأن تأثير الذكاء الاصطناعي على الوظائف مستقبلًا، حيث أن 55% منهم يعتقدون أن هذه التقنيات ستستولي على وظائفهم.

- سكان أمريكا الشمالية هم الأكثر تفاؤلًا بشأن مستقبل الذكاء الاصطناعي وتأثيره على الوظائف، حيث أن 25% منهم فقط عبروا عن قلقهم منه.

- 41% من الناس يظهرون قلقًا من أن أدوات الذكاء الاصطناعي ستزيد من كمية المعلومات المضلّلة المنتشرة على شبكة الإنترنت.

- يمكن استخدام الذكاء الاصطناعي في تشويه سمعة الشركات والاحتيال على الأعمال وسرقة البيانات من البريد الإلكتروني التجاري.

- هناك 5 وسائل لتخفيف مخاطر الذكاء الاصطناعي، تتمثل في التنظيم والشفافية وزيادة البحث والتطوير وتعليم الناس عنه والتمتع بالمسؤولية والشفافية.

- لتتمكن الشركات من حماية أعمالها من المخاطر التي مصدرها الذكاء الاصطناعي، عليها تكوين فرق متخصصة لتحديد التهديدات المحتملة وتحليلها والتصدي لها.